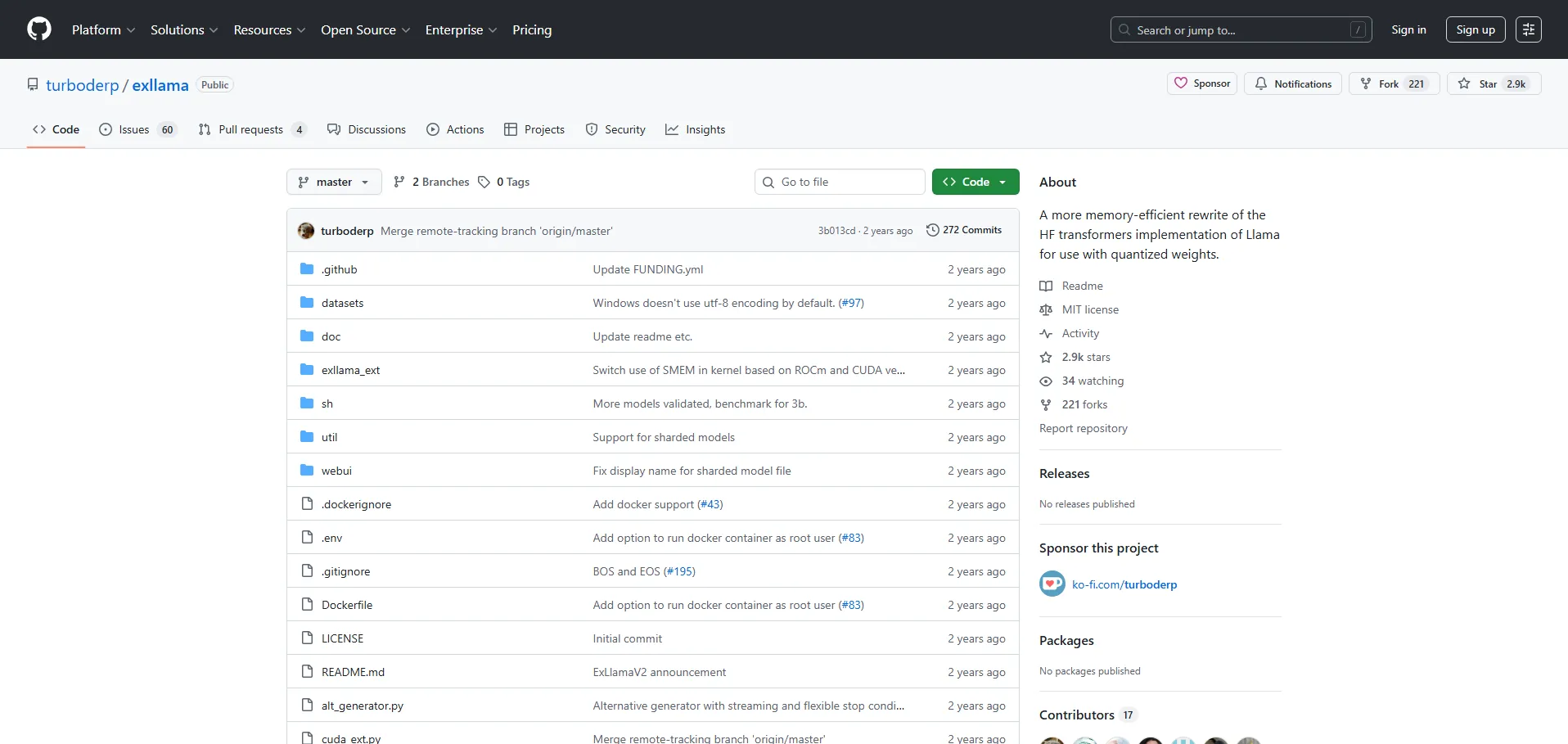

Exllama es una implementación de memoria eficiente para modelos de lenguaje basados en LLaMA de Hugging Face. Utiliza pesos cuantizados para reducir drásticamente el consumo de memoria en GPU modernas (incluida la serie RTX de NVIDIA), sin sacrificar el rendimiento en tareas de procesamiento de lenguaje natural (NLP). Con capacidades de modelos fragmentados, afinidad de procesador configurable y condiciones de parada flexibles, Exllama optimiza la inferencia y generación de texto en entornos con recursos limitados o de alto rendimiento.

🔹 Desarrolladores de IA: que necesitan ejecutar modelos LLaMA en GPU de consumo.

🔹 Investigadores en NLP: que buscan experimentar con cuantización y fragmentación.

🔹 Equipos de ciencia de datos: que optimizan recursos en proyectos de lenguaje natural.

🔹 Startups de IA: que despliegan prototipos de LLM con bajo coste de hardware.

🔹 Laboratorios académicos: que requieren inferencia eficiente para grandes modelos.

📌 Plan gratuito: acceso completo al repositorio open-source, actualizaciones comunitarias y soporte vía GitHub Issues.

Nota : Los precios están sujetos a cambios. Consulta siempre la información actualizada directamente en el sitio oficial de Exllama.

– Repositorio oficial en GitHub: https://github.com/tatsu-lab/exllama

– Documentación y guías de instalación: https://github.com/tatsu-lab/exllama/docs

– Comunidad y soporte: canal de Discord y GitHub Discussions para resolver dudas y compartir mejoras.

Ultimas IAS Listadas

Otras recomendaciones

Apúntate ya

Newsletter!